汉字藏着什么秘密?AI科学家刚刚才搞懂!

来源:https://www.douban.com/note/876777044/?_i=4850547C7J0Ow0

2025年10月21日,DeepSeek发的一篇叫作《DeepSeek-OCR: Contexts Optical Compression》的论文,在AI界炸锅了。

其实这个文章,普通人也是可以理解的。而且你会发现这是一篇超有意思的文章。

为了给大家掰扯清楚这个事儿,我们先从一个豆瓣热帖说起吧。

去年十月份,有个叫“请输入昵称”的豆友,在“我发现个规律”小组,发了一条帖子《我发现汉字上半部分似乎信息量更大一些》。

他是因为一次偶然的打印事故,发现页面上出现了两行“半个汉字”的句子,他注意到这些“半字”,如果是下半部分被切掉了,就不太影响阅读,但如果是上半部分切掉,阅读就会明显困难起来。

你不信也可以来试试。

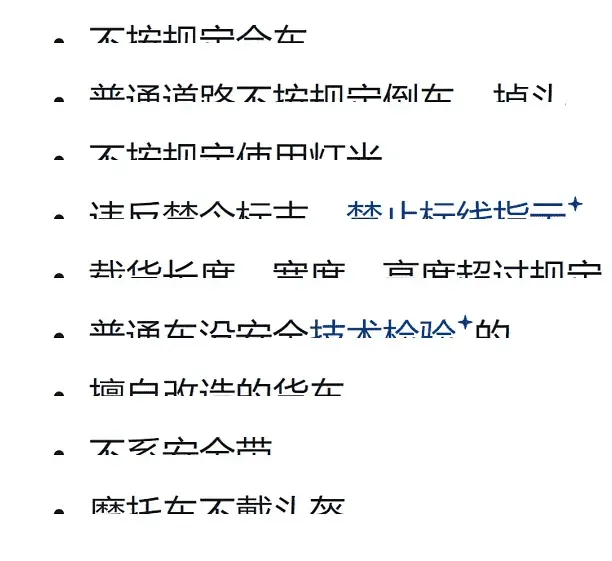

这个是他发的“下半体”:

你能看出来一些内容,但是不知道说的是啥,对吧,但你看“上半体”:

聪明的你,是不是基本上认了一个八九不离十?

那问题来了。难道我们老祖宗在几千年前造字的时候,就偷偷把一个字的灵魂全都塞在了上半部分吗?

其实,这个现象揭示了一个大脑工作的原理:人脑根本不是一台“扫描仪”,它是一台顶级的“压缩机”。

咱们以为阅读的时候,眼睛是在扫描每一个笔画。但是这就错了!你的大脑根本就没有仔细看,它只是快速抓住信息密度最高的关键特征(比如汉字的上半部分),然后立刻在你的“知识库”里搜索、匹配、解压出完整的字义。至于下半部分,大脑可能会觉得这部分信息太冗余了,不看也罢!

其实这个“bug”不只是中文独有。你去看英文也是一样的。这个就说明人类的视觉系统,都进化出了类似有损压缩的偷懒神技。

好,那这个跟DeepSeek的新论文有什么关系呢?这个论文其实就是在模拟人脑的这种识别能力。

现在的大模型,用比喻来说的话,它就不是压缩机,是真正的扫描仪。AI大模型处理一篇1000字的文档,它真的会一个字一个字地去读,产生 1000多个Text Token。文档越长,它越累,计算量爆炸式增长。在这个过程中它根本不懂什么叫抓重点,什么叫冗余信息。

DeepSeek这篇论文,就是想说,我们能不能不让AI傻乎乎地“读”字,而是教它像人一样“看”字呢?

还真的可以,他们干了件绝妙的事:把一篇密密麻麻的文字,拍成一张照片!

这张照片被AI压缩成极少数的“视觉Token”(比如100个)。这100个 Token就像我们刚刚看的“半个汉字”——它虽然是有损的、模糊的,但它抓住了整篇文档的关键视觉特征!

结果呢?AI解码器(Decoder)居然真的靠着这100个模糊的视觉Token,完美解压出了原文1000多个字的内容,准确率高达97%,实现了10倍的压缩率!

所以你看,你刚刚在半个汉字上体验到的大脑压缩算法,现在正被AI疯狂偷学。

这篇论文的真正意义,就是证明了“光学压缩”(把文本拍成照片)是解决AI长文本难题的天才之路。写到这里,还真有一种我们老祖宗的造字智慧和最前沿的AI科学接上头的感觉!

在这里要稍微简单说几个概念,为什么把文字变成图就能达成这个效果呢?

因为大模型的本质就是基于token的计算。现在大模型,有一张分词表,模型在计算你问的问题的时候,会查询这个表。并把句子切分成词汇表里“认识”的单词或子词,也就是token。所以,这种技术会导致Token的数量与你要处理的文本长度严格相关,线性增长。

如果你把这些文字弄到图片上,那么视觉模型它不关心你的文字是什么,它处理的是图片token,也就是说一张图切割成固定大小的网格,然后基于这些网格单元(图片token)去计算。那么这个时候,无论你文字多少,只要这个图片大小不变,那么它的token就是一个固定值。

而且相比文字token,图片token还编码了字体、字号、粗细、排版(分栏、行距)、表格线等。因为传统的文字Token是一维的线性序列,它天生就丢失了所有的排版、布局和几何关系。用文字Token描述一个复杂的几何图或化学分子式非常难。但图片Token不仅压缩了文本,还理解了文本的“空间结构”。所以,一些几何图形的识别效果也变好了。

因此DeepSeek论文里这个操作,可以说寻找到了一个更高信息压缩比的方法。这样一来有限的资源,就能更好地支持长上下文了。

更绝的是他们认为这个机制可以用来模拟人类的“记忆遗忘”。具体的方法是在多轮对话中,把比较久远的历史记录“渲染”成一张图来压缩保存。如果历史更久远,就把这张图的分辨率再降低(比如从Large模式降到Tiny模式),从而实现信息的“逐渐模糊”和“遗忘”,用极低的成本保留“几乎无限”的上下文。

总结一下,就是说:作为人类,我们可以从一个只剩上半部分内容的文字视觉信号中,解压出完整的语义。而DeepSeek的论文指出,机器也可以。

最后,容许我们畅想一下:从1D的文字序列,到2D的视觉处理,那会不会将来我们以3D token为单位进行计算呢?

还真有,这个概念叫体素(Voxels)也叫“3D像素”,还有一种东西叫“点云”,数百万个3D坐标点勾勒出物体表面,自动驾驶的激光雷达就在用这种技术,还有一种叫作“神经辐射场”的技术,直接生成3D场景,这都是模型升维的尝试。

如果你对量子力学略有所知的话,我们世界的体积不能细分到普朗克尺度以下,所以你会发现这种基于“体素”的算法,其实正是宇宙自己在做的事。一句话,人类最终的方向,其实就是在用计算机模拟宇宙。说不定,我们正好站在硅基智能睁开3D眼睛的前夜。

最后,推荐一本DeepSeek的技术书《DeepSeek原理与项目实战》。

一定要相信自己!有大模型辅助,每个人都应该开辟一个新的更高的阅读领域。